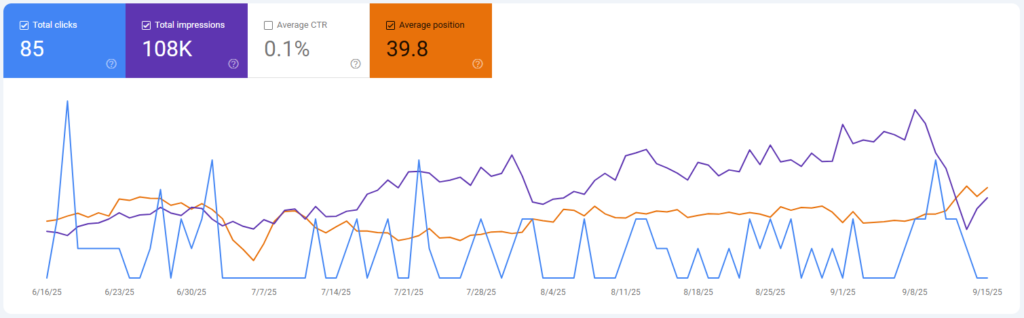

Durante Septiembre de 2025, muchos SEOs, webmasters y marketers nos dimos cuenta de algo raro: las impresiones en Google Search Console comenzaron a caer de forma inesperada. Lo primero que pensamos fue: ¿he perdido visibilidad?, ¿me habrá afectado una actualización del algoritmo?

La sorpresa vino después: no era una actualización de ranking, sino un pequeño cambio técnico de Google que está afectando a cómo se registran las impresiones.

¿Quieres aprender como hacer crecer tu negocio con SEO y Marketing digital de forma totalmente gratuita?

El parámetro &num=100 y su eliminación silenciosa

Hasta hace poco, había un truco bastante conocido: añadiendo el parámetro &num=100 a la URL de resultados de Google se podían ver 100 resultados de golpe en lugar de los 10 habituales. Esto no solo facilitaba la vida a usuarios avanzados, sino que también permitía a muchas herramientas SEO recopilar más datos con menos peticiones. Para un análisis en mayor profundidad, puedes leer el siguiente artículo: «Were we wrong about “The Great Decoupling” after all? Analyzing the impact of &num=100» (Brodie Clark, 2025).

A mediados de septiembre, Google eliminó silenciosamente esta opción. Ahora, aunque se agregue el parámetro, solo se muestran los 10 resultados de siempre. Esto ha obligado a las herramientas a multiplicar sus consultas para obtener la misma información y, de paso, ha reducido de golpe el “ruido” artificial que inflaba las impresiones en Search Console.

Entonces, ¿Por qué bajan las impresiones en Search Console?

La explicación es sencilla:

- Muchas de las impresiones que veíamos antes no correspondían a usuarios reales, sino a bots y consultas automáticas.

- Al eliminar este atajo, esas impresiones “infladas” han desaparecido, por lo que ahora los datos reflejan mejor la realidad de nuestras webs.

- La caída es más visible en sitios que reciben muchas impresiones en posiciones lejanas al Top 10.

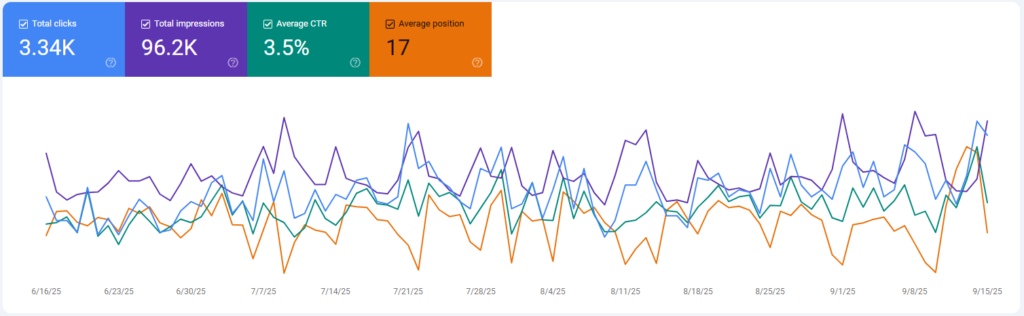

En otras palabras: no significa que tu web tenga menos visibilidad real, sino que ahora los números son más fieles a lo que pasa de verdad con los usuarios humanos. Casi todos profesionales del sector indican que (de momento), esta caída de impresiones no se ha visto reflejada en variaciones en clics y posiciones de palabras clave.

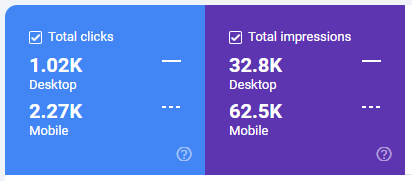

Un detalle interesante: esta caída de impresiones se nota más en sites cuyo tráfico principal es desktop. Tiene sentido, porque muchas de las búsquedas automatizadas que inflaban los datos venían de entornos de escritorio. Con el cambio del parámetro &num=100, ese “ruido” desaparece y las cifras reflejan mejor lo que realmente ven los usuarios.

En cambio, en sites con más tráfico mobile, la caída es mucho menos evidente. Allí esas peticiones masivas casi no existían, así que los datos ya eran más representativos del tráfico real. La buena noticia: aunque veas menos impresiones en desktop, no significa menos visibilidad; simplemente, Search Console ahora muestra métricas más limpias y realistas.

Por ejemplo, con este cliente no lo hemos notado (de momento xD)

¿A qué herramientas afecta este cambio?

Aunque a primera vista parezca un simple ajuste en los resultados de Google, el impacto se nota sobre todo en el ecosistema de herramientas SEO, plataformas de análisis y chatbots que dependen de consultas masivas.

Plataformas de tracking de posiciones

Herramientas que rastrean rankings en buscadores (como SEMrush, Sistrix, Ahrefs, SERanking, entre otras) usaban el parámetro &num=100 para extraer más resultados con menos peticiones. Ahora deben multiplicar las consultas por diez para obtener la misma cantidad de datos, lo que implica:

- Mayor consumo de recursos técnicos (tiempo, ancho de banda y servidores).

- Incremento de costes operativos, que podría trasladarse a los usuarios finales.

- Posibles limitaciones en la frecuencia o volumen de rastreo que ofrecen en sus planes.

Estas herramientas, que al final son softwares que hacen análisis masivo de keywords también se apoyaban en este parámetro para identificar oportunidades en páginas más allá del Top 10. Con este cambio, los datos sobre posiciones bajas, concretamente inferiores a top 20 serán más difíciles y costosos de obtener.

Según un artículo de Search Engine Journal, este cambio ha obligado a las herramientas a realizar más consultas para obtener la misma información, afectando la precisión de los datos de tracking de posiciones más allá del top 20, además de lo ocurrido en Google Search Console.

Semrush, una de las herramientas de tracking de keywords referencias del mercado, ya se ha pronunciado sobre cómo afecta esto a sus usuarios a la hora de hacer análisis: «los datos de los 20 primeros resultados siguen siendo totalmente fiables». Al mismo tiempo, advierte que “las clasificaciones más abajo en la página pueden ayudar a diagnosticar problemas (como la canibalización de palabras clave) o a detectar señales tempranas de crecimiento. Estas siguen siendo valiosas, pero tenga en cuenta que la visibilidad aquí puede fluctuar mientras la industria se adapta a este cambio”.

Tendremos que estar atentos a novedades de estas herramientas de cara a que puedan seguir mejorando, y volver a tener poco a poco una visión más amplia del evolutivo de keywords, más allá de la segunda o tercera página.

Plataformas de reporting y dashboards

Los sistemas que integran datos de Search Console y los presentan en informes personalizados (por ejemplo, dashboards de agencias) pueden mostrar caídas bruscas en las impresiones. Esto obliga a explicar a clientes y equipos internos que no se trata de una pérdida real de visibilidad, sino de un ajuste técnico de Google.

Herramientas de nicho y scrapers caseros

Muchos SEOs usaban scripts o herramientas propias basadas en el parámetro &num=100. Todos estos métodos dejan de funcionar de golpe, obligando a reprogramar procesos internos o buscar alternativas.

Fuentes de consulta de los chatbots

Otro punto interesante es el papel de los chatbots basados en IA. Modelos como ChatGPT o Perplexity utilizan datos de búsqueda para entrenarse o responder a preguntas de los usuarios. La eliminación de este parámetro puede tener un efecto directo en:

- Reducir el acceso masivo a listados completos de resultados.

- Limitar la calidad y diversidad de las fuentes a las que acceden estos sistemas.

- Forzar a que estas herramientas dependan más de APIs oficiales de Google (o de acuerdos comerciales) en lugar de scrapers no autorizados.

En otras palabras, Google también está protegiendo su propio ecosistema de datos ante el auge de los modelos de lenguaje que compiten por convertirse en la puerta de entrada a la información.

¿Y qué podemos hacer ahora los SEOs?

Bajo mi punto de vista, lo que en un principio pudo suponer un susto inicial, se convierte realmente en algo que tiene su lógica, y que creo que hay aprendizajes valiosos:

1. Poner el foco en el Top 10

Que el objetivo de todo SEO sea alcanzar las primeras posiciones no es ninguna novedad. Lo interesante de este cambio es que ahora incluso las propias herramientas tendrán serias dificultades para trackear lo que ocurre más allá del Top 20.

Esto significa que seguir de cerca posiciones muy bajas (página tres en adelante) pierde todavía más sentido. Si los usuarios rara vez llegan hasta allí y las métricas dejan de ser fiables, ¿para qué gastar energía en ese terreno?

Y que no se malinterprete esto. Contra más acceso tengamos a mayores datos de ranking y evolutivo de palabras clave, mejor para nuestros análisis, ver que palabras clave están funcionando mejor, sobre todo para ver si van dando resultados o no las optimizaciones realizadas más recientemente. Sin embargo, habrá que priorizar acciones en función a las nuevas posibilidades y recursos que tengamos.

El verdadero valor está en concentrar esfuerzos en el Top 10, que es donde se juega la visibilidad real, se generan clics y se mueven las conversiones, y por supuesto el top 20, dónde se encuentran muchas oportunidades de posicionamiento corrigiendo una serie de optimizaciones (según el estado de la web). En definitiva, Google nos está recordando lo que siempre hemos sabido, pero ahora con un empujón extra para dejar de mirar el “fondo de las SERPs”.

2. Analizar tendencias en vez de obsesionarse con números absolutos

Que un gráfico de Search Console baje puede asustar, pero lo importante no es el número total de impresiones, sino revisar si los clics y posiciones de palabras claves se mantienen o crecen.

Resulta que la mayoría de sites que han acusado esta bajada de tráfico, no han notado variaciones en sus clics e impresiones, por lo que en este sentido las impresiones de Search Console serán más significativas y reales (Ya que lo que está por debajo del top 10, no lo ve nadie.

3. Usar la caída de impresiones como un “reseteo”

En cierto modo, Google nos está obligando a mirar los datos con otros ojos. Se acabaron las métricas infladas: lo que queda ahora es información más cercana al comportamiento real de las personas.

Aprendizajes que podemos extraer:

La caída de impresiones en Search Console abre también otras preguntas e intenciones futuras que podemos explorar:

- Cómo medir mejor la visibilidad orgánica sin depender de métricas infladas.

- Qué estrategias seguir para aparecer en el Top 10 con mayor frecuencia.

- Cómo optimizar CTR y no solo posiciones, ahora que sabemos que impresiones lejanas ya cuentan menos.

- Qué otros cambios silenciosos podría aplicar Google que afecten a nuestras métricas y cómo anticiparnos a ellos.

Reflexión final

Personalmente, creo que este cambio es un recordatorio: los datos en SEO no son una verdad absoluta, son una aproximación. Y cada cierto tiempo, Google mueve una pieza que nos obliga a recalibrar cómo interpretamos lo que vemos.

Sí, puede dar miedo ver que las impresiones bajan de golpe, pero también es una oportunidad para trabajar con números más limpios y tomar decisiones más realistas. Al final, lo que de verdad importa es simple: que los usuarios lleguen, encuentren lo que buscan y conviertan.

¿Quieres aprender como hacer crecer tu negocio con SEO y Marketing digital de forma totalmente gratuita?

Soy Daniel Caro García, consultor SEO con experiencia en ayudar a empresas de mediana y gran envergadura a mejorar su visibilidad online, trabajando tanto en agencia como en cliente final.

Me apasiona el SEO técnico y el análisis del comportamiento del usuario, lo que me permite desarrollar soluciones que no solo mejoran el posicionamiento, sino que también aportan valor real a las marcas con las que trabajo. A través de mi blog, comparto conocimientos, tendencias y estrategias prácticas que facilitan a otros profesionales y empresas mantenerse al día en un entorno digital en constante evolución.

Mi objetivo es ofrecer resultados medibles basados en datos y siempre dentro de las mejores prácticas de SEO, creando una presencia online sólida, ética y de confianza para mis clientes.